A ascensão meteórica da Inteligência Artificial (IA), especialmente da IA Generativa, marcou um ponto de inflexão na história tecnológica. Enquanto empresas correm para integrar algoritmos que aumentam a produtividade e a criatividade, uma corrida paralela e sombria acontece nos bastidores da internet. A mesma tecnologia que promete curar doenças e otimizar logísticas está reescrevendo as regras do cibercrime.

No cenário atual de segurança digital, a IA não é apenas uma ferramenta; ela é um multiplicador de forças que está alterando fundamentalmente a assimetria entre atacantes e defensores.

1. A Democratização do Cibercrime

Historicamente, ataques cibernéticos sofisticados exigiam anos de experiência em programação e conhecimento profundo de redes. A IA reduziu drasticamente essa barreira de entrada.

Ferramentas baseadas em grandes modelos de linguagem (LLMs) podem ser exploradas para escrever códigos maliciosos, criar scripts de invasão ou identificar vulnerabilidades em softwares populares. Isso significa que atores mal-intencionados com pouco conhecimento técnico (“script kiddies”) agora possuem capacidades que antes eram exclusivas de grupos de hackers de elite ou estados-nação.

O Desafio: O volume de ataques está aumentando porque o custo e o esforço para lançá-los diminuíram drasticamente.

2. A Evolução da Engenharia Social

Talvez o risco mais imediato e visível seja o aprimoramento da engenharia social. Os dias de e-mails de phishing mal escritos, cheios de erros gramaticais e formatação duvidosa, estão contados.

- Phishing Hiper-Personalizado: A IA pode analisar a pegada digital de um alvo (LinkedIn, redes sociais) e criar mensagens de spear-phishing indistinguíveis de comunicações reais, adotando o tom de voz de chefes ou colegas.

- Deepfakes e Fraudes de Identidade: A clonagem de voz e vídeo em tempo real já é uma realidade. Casos de fraudes financeiras onde um funcionário transfere fundos após receber uma videochamada falsa de um CFO (criada por IA) já foram registrados globalmente.

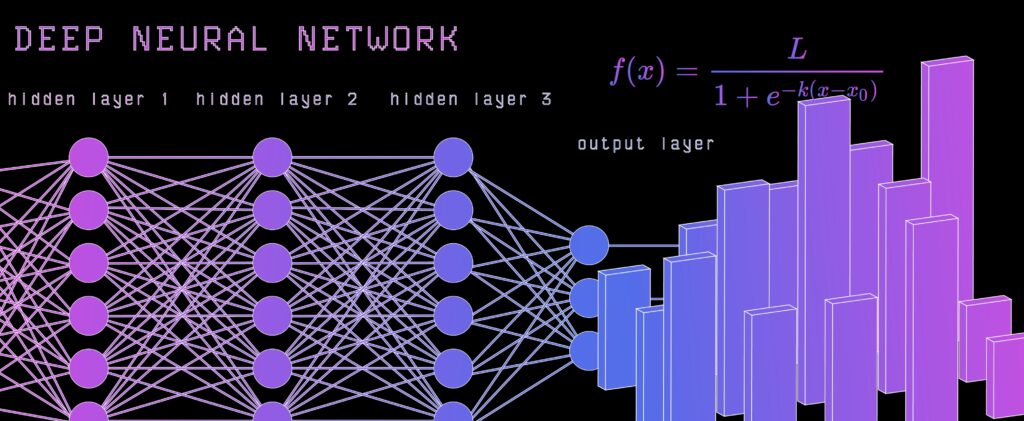

3. Vetores de Ataque Automatizados e Adaptativos

A IA permite que o malware seja “inteligente”. Diferente dos vírus estáticos do passado, o novo malware impulsionado por IA pode ser:

- Polimórfico: O código se reescreve constantemente para evitar a detecção por antivírus baseados em assinatura.

- Autônomo: Agentes de IA podem tomar decisões durante um ataque, escolhendo quais dados exfiltrar ou como se mover lateralmente dentro de uma rede sem precisar de comando e controle humano constante.

Tabela: Ataque Tradicional vs. Ataque Impulsionado por IA

| Característica | Ciberataque Tradicional | Ciberataque com IA |

|---|---|---|

| Personalização | Baixa (envio em massa) | Alta (contextualizada por alvo) |

| Velocidade | Limitada pela ação humana | Velocidade de máquina |

| Evasão | Estática | Dinâmica e adaptativa |

| Escala | Linear | Exponencial |

4. O Risco do “Envenenamento de Dados” (Data Poisoning)

À medida que as organizações dependem mais de modelos de Machine Learning para tomar decisões de segurança, surge um novo risco: o ataque aos próprios dados.

Se um atacante conseguir infiltrar dados falsos no conjunto de treinamento de uma IA de defesa, ele pode ensinar o sistema a ignorar comportamentos maliciosos específicos. É como treinar um cão de guarda para acreditar que ladrões vestindo uma cor específica são amigáveis. A integridade dos dados torna-se, portanto, tão crítica quanto a segurança da infraestrutura.

5. O Futuro: A Guerra de Algoritmos

A única maneira eficaz de combater uma IA ofensiva é com uma IA defensiva. Estamos entrando em uma era de “guerra algorítmica”, onde sistemas de defesa autônomos precisarão detectar e neutralizar ameaças em milissegundos, sem intervenção humana.

As organizações devem adotar uma postura de Zero Trust (Confiança Zero), onde nenhuma entidade — interna ou externa — é confiável por padrão, e a verificação é contínua e impulsionada por análise comportamental via IA.

Conclusão

A Inteligência Artificial não é a vilã, mas é uma ferramenta poderosa que não possui bússola moral. Para líderes de TI e segurança, a mensagem é clara: a complacência é o maior risco. A segurança digital no mundo pós-IA exige vigilância constante, educação contínua das equipes contra deepfakes e engenharia social, e o investimento em defesas que possam “pensar” tão rápido quanto os ataques que enfrentam.